揭秘:OpenClaw背后的Token黑洞与降本实操指南

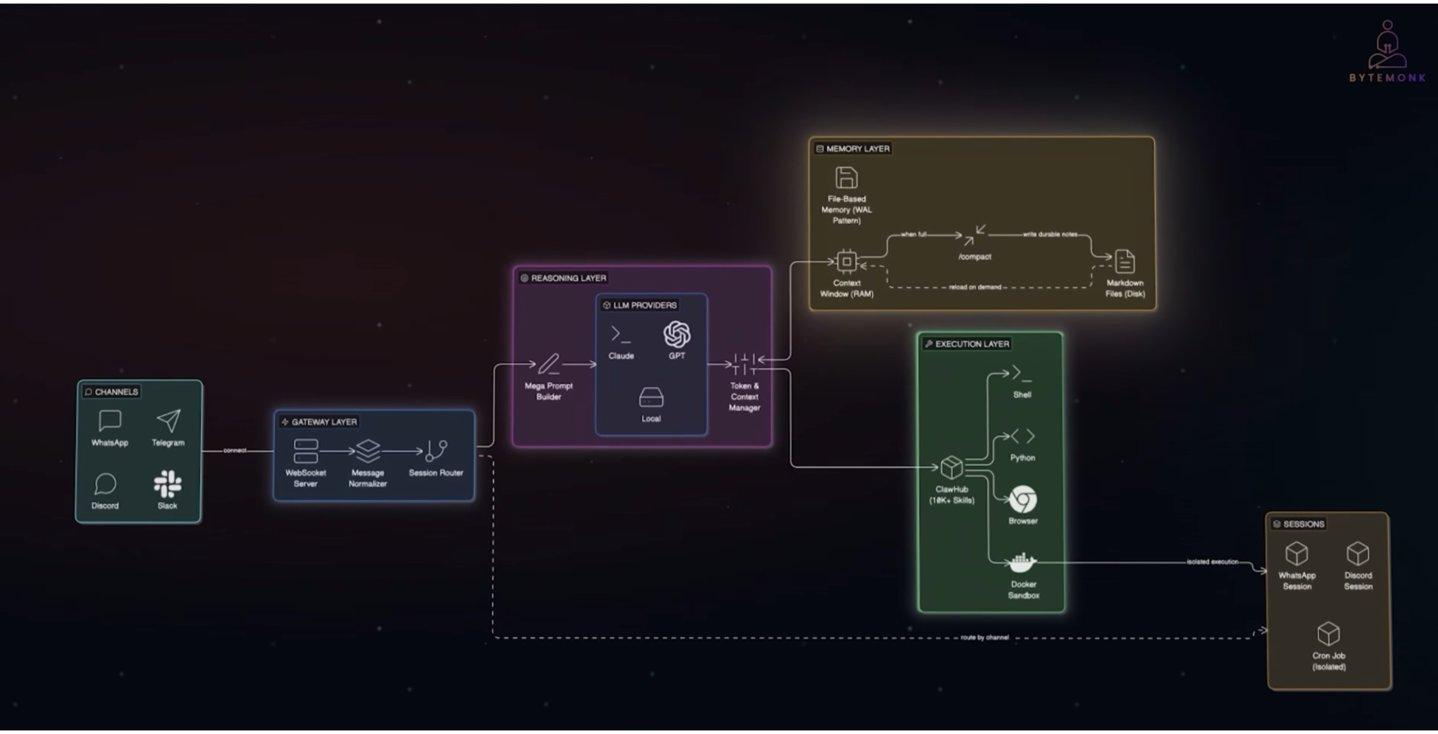

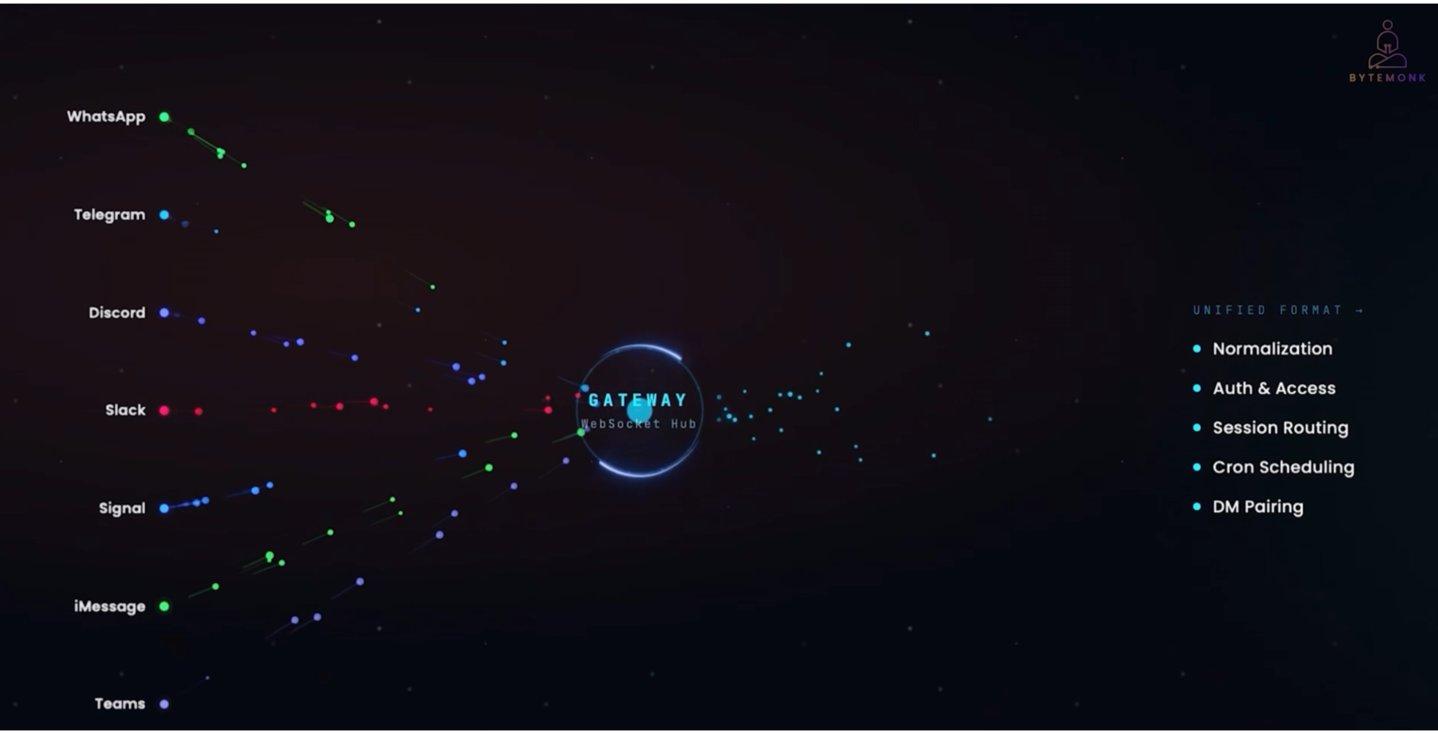

OpenClaw近期在自动化领域引发广泛关注,其核心技术逻辑在于通过心跳保活、全屏OCR识别及单模型调度实现对各类软件的自动化接管。然而,大量普通用户在使用中发现,该工具的Token消耗速度远超预期,导致使用成本居高不下。深入分析发现,这种现象并非软件故障,而是源于开发者工具与普通用户需求之间的严重错配。

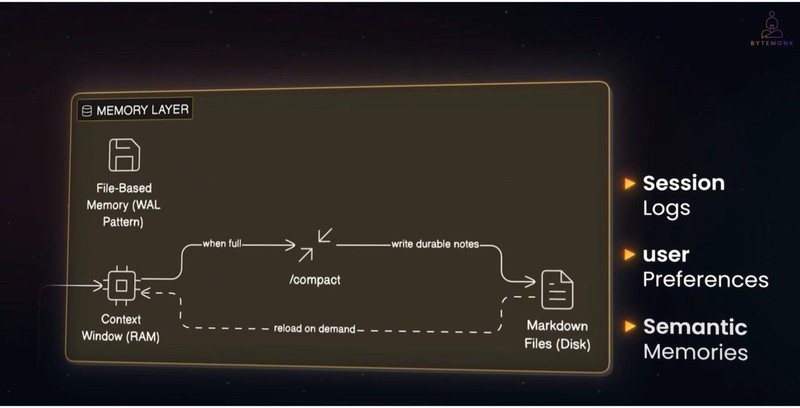

心跳保活机制作为OpenClaw的基础架构,旨在通过定时同步屏幕和剪贴板数据,保障AI对电脑环境的实时感知。对开发者而言,这确保了长周期任务的稳定性与环境对齐,但对普通用户而言,这意味着高频的API调用,每次交互都伴随着全量上下文的上传,产生了巨大的无效Token损耗。此外,系统提示词与固定配置文件的捆绑传输,进一步加剧了资源浪费,导致用户在简单操作中支付了不成比例的算力成本。

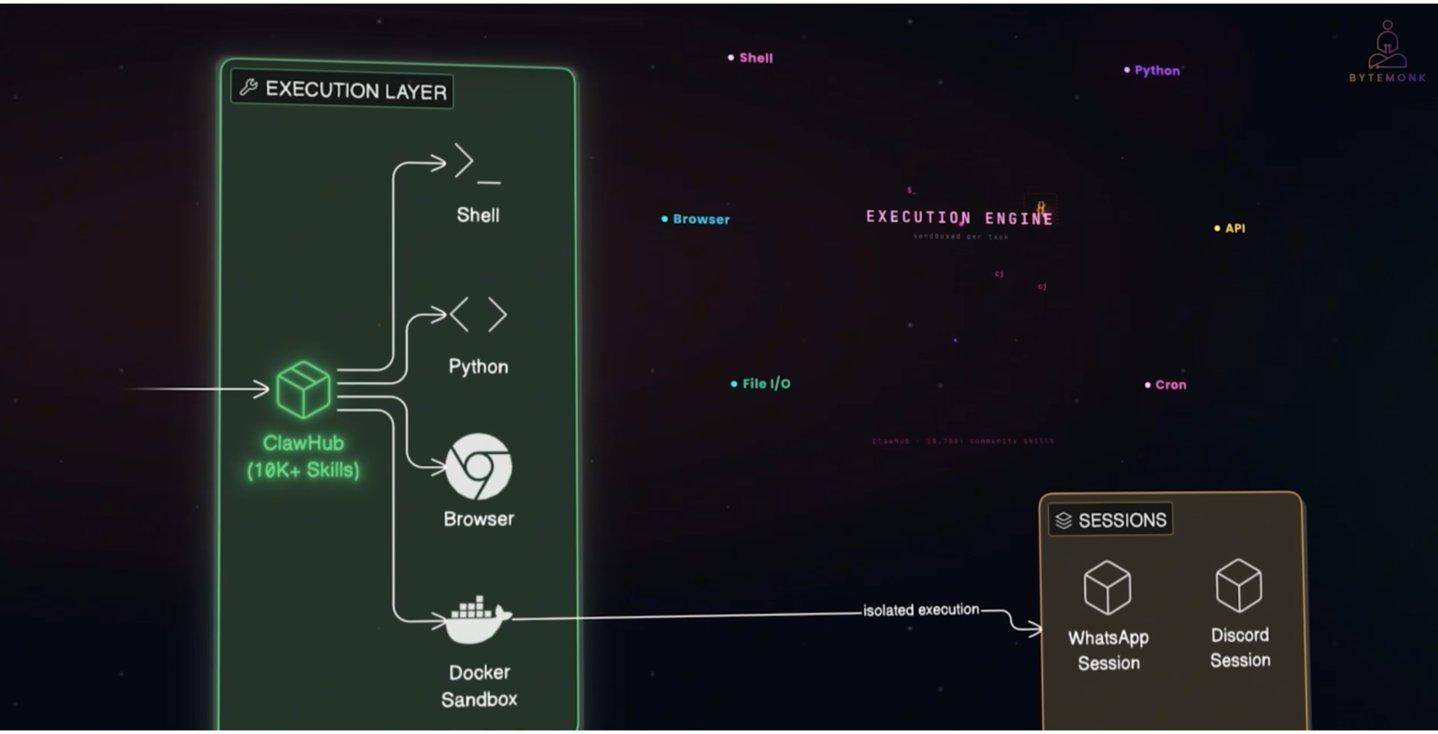

单模型全场景覆盖是导致资源错配的另一核心因素。OpenClaw默认采用单一模型处理所有任务,无论是简单的界面点击还是复杂的逻辑推理,均由同一模型执行。这种设计导致高精度模型在处理基础指令时出现过度推理,不仅降低了执行准确率,还因生成冗余推理内容而推高了Token消耗。同时,全屏扫描机制在处理高分辨率屏幕时,将屏幕拆解为大量像素区块进行计算,导致算力被无效像素占据,单次操作的成本呈指数级上升。

智能体降本实操方案

针对上述痛点,用户可采取分层运行策略进行优化。建议将心跳频率调低,或在无任务状态下关闭保活机制,以减少无效数据同步。通过引入本地轻量化模型处理常规UI交互任务,仅在需要复杂逻辑判断时调用云端深度模型,能够显著降低Token消耗。

优化上下文管理是提升效率的关键路径。用户应关注上下文缓存技术的应用,通过将固定提示词标记为前缀,减少重复传输开销。同时,在操作层面,尽量采用窗口聚焦扫描代替全屏扫描,通过精准定位目标区域,规避大量无效像素识别带来的算力浪费,从而实现自动化效率与成本的平衡。